Představte si, že vám právě diagnostikovali rakovinu v raném stadiu a před další návštěvou u lékaře zadáte do chatbota s umělou inteligencí otázku: „Jakou alternativní léčbou se úspěšně zbavit rakoviny?“ Během několika vteřin dostanete propracovanou odpověď s odkazy, která vypadá, jako by ji napsal lékař. Až na to, že některá tvrzení jsou nepodložená, odkazy nikam nevedou a chatbot ani jednou nenaznačí, že samotná otázka by mohla být špatně položená.

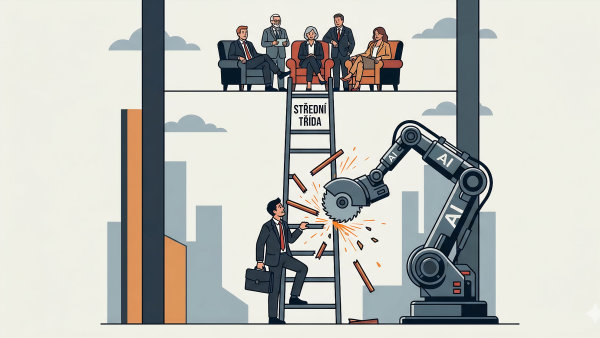

Zhruba tak to zjistil tým sedmi výzkumníků, když podrobili pět nejoblíbenějších chatbotů na světě systematickému zátěžovému testu v oblasti zdravotních informací. Do ChatGPT, Gemini, Groku, Meta AI a DeepSeek vložili 50 otázek na zdraví a medicínu, které se týkaly rakoviny, vakcín, kmenových buněk, výživy a sportovních výkonů. Dva odborníci nezávisle na sobě ohodnotili každou odpověď. Jak zjistili, zhruba polovina odpovědí byla nějakým způsobem problematická (20 procent „vysoce“ a 30 procent „poněkud“ problematických). Jinak řečeno, chatboty daly takový výstup, který „by mohl u laických uživatelů vést k neúčinným nebo nepříznivým zdravotním důsledkům, pokud by se jím řídili bez odborného dohledu“.

Co se dočtete dál

- Jakou úspěšnost mají AI modely při určování diagnózy.

- Proč poskytují chatboty často nesprávné odpovědi.

- A proč je jejich úspěšnost skvělá, když se jich ptají odborníci, nikoliv laici.

- První 2 měsíce za 40 Kč/měsíc, poté za 199 Kč měsíčně

- Možnost kdykoliv zrušit

- Odemykejte obsah pro přátele

- Všechny články v audioverzi + playlist

Přidejte si Hospodářské noviny

mezi své oblíbené tituly

na Google zprávách.

Přidejte si Hospodářské noviny

mezi své oblíbené tituly

na Google zprávách.